Fine tuning: o que é e como especializar modelos de ia para contratos

Descubra o que é fine tuning, como funciona o ajuste fino de modelos de IA e veja como a Docusign Iris usa essa técnica para revolucionar a gestão dos contratos.

Fine tuning, ou ajuste fino, representa uma das técnicas mais importantes da inteligência artificial moderna. Consiste em continuar o treinamento de um modelo pré-treinado usando um conjunto menor e mais específico de dados, dando ao modelo conhecimento especializado para tarefas particulares.

Nesse sentido, o processo aproveita bilhões de parâmetros já otimizados durante o pré-treinamento em vastos corpus de dados. Em vez de treinar um modelo do zero, portanto, o fine tuning ajusta esses parâmetros existentes para domínios específicos, mantendo o conhecimento geral enquanto adiciona especialização.

Por sua vez, a eficiência do fine tuning reside na transferência de aprendizado. Um modelo que aprendeu padrões linguísticos gerais pode, dessa forma, ser rapidamente adaptado para compreender terminologia jurídica, médica ou financeira por meio de exemplos específicos desses domínios.

Segundo dados do Stanford AI Index 2025 se abre en una nueva pestaña, o número de modelos de base está dobrando ano a ano, criando mais opções para fine tuning. Esta proliferação, consequentemente, democratiza o acesso à IA avançada, permitindo que empresas menores implementem soluções sofisticadas.

Como funciona o processo de fine tuning?

Seleção do modelo base: escolha o modelo base (LLM) considerando seu tamanho, arquitetura e domínio de pré-treinamento mais adequados para a tarefa final de especialização.

Preparação dos dados (dataset): prepare um dataset de treinamento com alta qualidade e representatividade do domínio alvo. A qualidade dos dados é priorizada sobre a quantidade neste estágio.

Treinamento e ajuste de parâmetros: realize o treinamento ajustando apenas uma fração dos parâmetros originais do modelo. Utilize técnicas como Parameter-Efficient Fine-Tuning (PEFT) para reduzir os recursos computacionais.

Monitoramento contínuo e avaliação: monitore o treinamento para evitar overfitting e esquecimento catastrófico. Use métricas específicas do domínio para garantir que o modelo esteja aprendendo os padrões relevantes.

Um exemplo prático de fine tuning é o conceito de contract intelligence. Nele, modelos especializados em contratos compreendem nuances jurídicas que modelos genéricos não capturam, oferecendo análises mais precisas e relevantes.

Métodos de fine tuning

O fine tuning completo atualiza todos os parâmetros do modelo, maximizando a adaptação ao novo domínio. Esta abordagem oferece melhor performance, mas requer recursos computacionais significativos e pode causar esquecimento do conhecimento original.

Por outro lado, Parameter-Efficient Fine-Tuning (PEFT) revolucionou o campo ao permitir especialização com recursos mínimos. Técnicas como LoRA (Low-Rank Adaptation) inserem pequenas matrizes treináveis nas camadas do modelo, mantendo os pesos originais congelados.

Nesse contexto, LoRA pode treinar modelos de 65 bilhões de parâmetros se abre en una nueva pestaña em uma única GPU de 48 GB, comparado aos recursos massivos necessários para fine tuning completo. Além disso, os adaptadores LoRA ocupam apenas alguns megabytes, facilitando armazenamento e compartilhamento.

QLoRA (Quantized LoRA), por sua vez, combina quantização 4-bit com LoRA, permitindo fine tuning de modelos ainda maiores em hardware consumer. Esta técnica, portanto, democratizou o acesso a modelos de grande escala para pesquisadores individuais e startups.

Preparação de dados para fine tuning

A curadoria de dados para fine tuning requer abordagem diferente do treinamento inicial. Neste caso, qualidade supera quantidade — conjuntos menores e bem estruturados produzem melhores resultados que datasets massivos, mas ruidosos.

Além disso, a diversidade dentro do domínio específico é crucial. Para contratos, isso significa incluir diferentes tipos de acordos, jurisdições e estilos de redação. A representatividade, dessa forma, garante que o modelo generalize bem dentro do domínio alvo.

Por outro lado, formato e estruturação adequados aceleram o aprendizado. Dados organizados em pares pergunta-resposta, exemplos de entrada-saída ou sequências estruturadas facilitam a compreensão do modelo sobre padrões desejados.

Finalmente, validação rigorosa identifica vieses ou lacunas nos dados de treinamento. Técnicas de validação cruzada e testes em dados não vistos garantem que o modelo aprenda padrões generalizáveis, não apenas memorize exemplos específicos.

Quando usar fine tuning?

Fine tuning é ideal quando você tem dados específicos do domínio e precisa de performance superior a modelos genéricos. Dessa forma, a técnica brilha em cenários onde terminologia especializada, padrões únicos ou contextos específicos são cruciais para o sucesso.

Por sua vez, a análise custo-benefício favorece fine tuning quando o volume de uso justifica o investimento inicial. Para empresas que processam milhares de documentos mensalmente, portanto, a melhoria na precisão compensa os custos de desenvolvimento e treinamento.

Comparado a alternativas como RAG (Retrieval-Augmented Generation), o fine tuning oferece conhecimento internalizado. Enquanto RAG busca informações em bases externas, por outro lado, modelos com fine tuning têm conhecimento especializado incorporado em seus parâmetros.

Além disso, a decisão entre fine tuning e prompt engineering depende da complexidade da tarefa. Prompts funcionam bem para instruções simples, mas fine tuning é necessário quando o modelo precisa compreender nuances profundas do domínio.

Descubra como a Docusign Iris utiliza fine tuning para revolucionar a gestão de contratos, oferecendo análises precisas e insights acionáveis para empresas de todos os portes.

Fine tuning vs treinamento do zero

O treinamento do zero requer recursos computacionais massivos e datasets enormes. Nesse contexto, um modelo de linguagem moderno pode custar milhões de dólares para treinar completamente, demandando clusters de centenas de GPUs por semanas ou meses.

Por outro lado, fine tuning reduz esses custos drasticamente, aproveitando o conhecimento já incorporado em modelos pré-treinados. O tempo de desenvolvimento, consequentemente, cai de meses para dias ou semanas, acelerando significativamente o time-to-market.

Além disso, a qualidade dos resultados favorece fine tuning para a maioria das aplicações empresariais. Modelos pré-treinados já possuem compreensão linguística sofisticada, precisando apenas de especialização para domínios específicos.

Dessa forma, treinamento do zero só se justifica quando você tem datasets únicos de escala massiva e recursos computacionais ilimitados. Para a maioria das empresas, portanto, fine tuning oferece melhor retorno sobre investimento.

Fine tuning vs RAG (Retrieval-Augmented Generation)

RAG combina modelos de linguagem com bases de conhecimento externas, buscando informações relevantes durante a geração. Esta abordagem, por sua vez, funciona bem para conhecimento factual que muda frequentemente.

Por outro lado, fine tuning internaliza conhecimento nos parâmetros do modelo, oferecendo acesso mais rápido e consistente. Modelos com fine tuning, dessa forma, não dependem de sistemas externos, reduzindo latência e pontos de falha.

Nesse sentido, a escolha entre RAG e fine tuning depende da natureza do conhecimento. Para fatos que mudam rapidamente, RAG oferece flexibilidade. Para padrões estáveis e compreensão profunda de domínio, no entanto, fine tuning é superior.

Além disso, abordagens híbridas combinam ambas as técnicas. Um modelo com fine tuning para compreensão de contratos pode usar RAG para acessar jurisprudência atualizada, oferecendo o melhor dos dois mundos.

Benefícios do fine tuning para empresas

Democratização da IA: permite que empresas de qualquer porte implementem soluções sofisticadas, reduzindo os custos computacionais necessários para especializar modelos.

Vantagem competitiva (especialização setorial): modela o aprendizado para terminologias, padrões e contextos únicos de cada indústria, oferecendo insights mais profundos que modelos genéricos.

Eficiência operacional: melhora drasticamente a performance ao automatizar tarefas manuais com precisão superior, liberando profissionais para foco estratégico.

Aceleração da transformação digital: permite a implementação rápida da IA em processos específicos, sem a necessidade de infraestrutura complexa e demorada.

A transformação digital acelera quando empresas adotam fine tuning. A técnica, portanto, permite implementar IA em processos específicos rapidamente, sem necessidade de infraestrutura complexa.

Eficiência computacional

Fine tuning com técnicas PEFT pode usar 12-20 se abre en una nueva pestaña vezes menos memória GPU que treinamento completo. Esta eficiência, dessa forma, permite que empresas menores acessem modelos de grande escala sem investimentos massivos em infraestrutura.

Por outro lado, a sustentabilidade energética do fine tuning é superior ao treinamento do zero. Menor consumo computacional resulta em menor pegada de carbono, alinhando-se com objetivos de ESG empresariais.

Além disso, o tempo de treinamento reduzido acelera ciclos de desenvolvimento. Equipes podem iterar rapidamente, testando diferentes abordagens e refinando modelos com base em feedback real dos usuários.

Consequentemente, a economia em infraestrutura é substancial. Uma única GPU pode realizar fine tuning de modelos que exigiriam clusters inteiros para treinamento completo, democratizando o acesso à IA avançada.

Especialização setorial

O vocabulário especializado de cada setor requer compreensão profunda que apenas fine tuning pode oferecer. Dessa forma, termos técnicos, jargões e contextos específicos são internalizados durante o processo de ajuste fino.

Por sua vez, a compreensão de contextos únicos diferencia modelos especializados. Em contratos, isso significa reconhecer implicações de cláusulas específicas, identificar riscos potenciais e sugerir melhorias baseadas em melhores práticas setoriais.

Além disso, a melhoria em tarefas especializadas é mensurável. Estudos mostram que fine tuning pode melhorar a precisão para tarefas específicas, comparado a modelos genéricos.

Nesse contexto, setores como jurídico, saúde e finanças se beneficiam especialmente do fine tuning. A complexidade regulatória e terminológica desses domínios requer especialização que apenas ajuste fino pode proporcionar.

Implementando fine tuning na sua empresa

O sucesso na implementação do fine-tuning depende de um planejamento estratégico que abrange desde a definição de metas até a capacitação da equipe.

Definição de objetivos e métricas: defina de forma clara quais são os objetivos do projeto de fine-tuning e estabeleça as métricas de sucesso que serão utilizadas para avaliar o desempenho do modelo especializado.

Escolha da plataforma de fine tuning: selecione a plataforma mais adequada, considerando orçamento, expertise equipe, requisitos de segurança e a sensibilidade dos dados (serviços gerenciados ou soluções on-premises).

Preparação da infraestrutura e recursos: avalie e prepare os recursos computacionais necessários. Considere o uso de técnicas PEFT (Parameter Efficient Fine Tuning) para reduzir significativamente os requisitos de hardware.

Desenvolvimento de competências internas: invista em treinamento para a equipe, focando em ferramentas e técnicas de fine tuning, melhores práticas de desenvolvimento e manutenção de modelos.

Profissionais de Legal Ops e IA podem se beneficiar especialmente do fine tuning para automatizar análises contratuais, liberando tempo para atividades estratégicas de maior valor.

Escolhendo dados para fine tuning

A seleção criteriosa de dados determina o sucesso do fine tuning. Dessa forma, dados devem ser representativos do domínio alvo, cobrindo variações e casos extremos que o modelo encontrará em produção.

Por sua vez, a quantidade mínima necessária varia conforme a complexidade da tarefa. Para fine tuning básico, centenas de exemplos podem ser suficientes, enquanto tarefas complexas podem requerer milhares de amostras bem curadas.

Nesse contexto, a qualidade supera volume em todos os cenários. Dados limpos, bem rotulados e validados por especialistas produzem melhores resultados do que datasets massivos, mas ruidosos.

Além disso, a preparação e limpeza incluem remoção de informações sensíveis, padronização de formatos e validação de consistência. Investimento nesta etapa se reflete diretamente na qualidade do modelo final.

Ferramentas e plataformas recomendadas

Opções open source como Hugging Face Transformers oferecem flexibilidade máxima para equipes técnicas. A biblioteca PEFT simplifica implementação de técnicas eficientes como LoRA e QLoRA.

Por outro lado, plataformas gerenciadas como OpenAI API, Google Vertex AI e AWS SageMaker abstraem complexidade técnica. Estas opções são ideais para equipes que priorizam rapidez de implementação sobre customização.

Soluções híbridas combinam flexibilidade de ferramentas open source com conveniência de serviços gerenciados. Frameworks como Axolotl facilitam fine tuning de modelos populares com configuração simplificada.

Dessa forma, a escolha depende de fatores como orçamento, expertise técnica, requisitos de segurança e escala de operação. Avaliação cuidadosa destes critérios orienta a decisão mais adequada para cada organização.

Desafios e limitações do fine tuning

O primeiro desafio é o overfitting, que representa risco significativo quando dados de treinamento são limitados. Neste caso, o modelo pode memorizar exemplos específicos sem aprender padrões generalizáveis, resultando em performance pobre em dados não vistos.

Por outro lado, esquecimento catastrófico pode ocorrer quando fine tuning excessivo faz o modelo perder conhecimento original. Balancear especialização com preservação de capacidades gerais requer técnicas cuidadosas de regularização.

Além disso, a qualidade dos dados de treinamento impacta diretamente os resultados. Dados enviesados, incompletos ou incorretos podem introduzir comportamentos indesejados no modelo final.

Finalmente, os recursos computacionais, embora reduzidos comparado ao treinamento do zero, ainda podem ser significativos para modelos muito grandes. Planejamento adequado de infraestrutura é essencial para projetos de sucesso.

A gestão inteligente de acordos exemplifica como superar estes desafios mediante implementação cuidadosa e monitoramento contínuo de performance.

Como evitar overfitting

Técnicas de regularização como dropout e weight decay penalizam a complexidade excessiva durante o treinamento. Estas técnicas incentivam o modelo a aprender padrões gerais em vez de memorizar exemplos específicos.

Validação cruzada divide dados em conjuntos de treinamento e validação, permitindo monitoramento de performance em dados não vistos. Parada antecipada interrompe treinamento quando performance de validação para de melhorar.

Indo além, o monitoramento de métricas específicas do domínio identifica sinais de overfitting. Divergência entre performance de treinamento e validação indica necessidade de ajustes no processo.

Finalmente, ajuste cuidadoso de hiperparâmetros como taxa de aprendizado e número de épocas previne treinamento excessivo. Experimentação sistemática identifica configurações ótimas para cada dataset específico.

Gerenciando esquecimento catastrófico

Esquecimento catastrófico ocorre quando, durante o processo de fine tuning, o modelo de linguagem sobrescreve conhecimento útil do modelo original. Este fenômeno é especialmente problemático quando o modelo precisa manter capacidades gerais além da especialização.

Nesse contexto, estratégias de prevenção incluem fine tuning gradual com taxas de aprendizado baixas. Mudanças incrementais preservam melhor o conhecimento original enquanto incorporam nova especialização.

Por outro lado, técnicas de preservação de conhecimento como Elastic Weight Consolidation (EWC) identificam parâmetros importantes para tarefas anteriores e os protegem durante fine tuning. Esta abordagem matemática quantifica a importância de cada parâmetro.

Além disso, balanceamento entre especialização e generalização requer monitoramento contínuo. Testes regulares em tarefas gerais garantem que o modelo mantém capacidades básicas enquanto desenvolve expertise específica.

Futuro do fine tuning

Tendências emergentes apontam para democratização crescente do fine tuning. Dessa forma, ferramentas mais acessíveis e técnicas mais eficientes tornarão a especialização de modelos disponível para empresas de todos os portes.

Por sua vez, automação de fine tuning promete simplificar o processo mediante seleção automática de hiperparâmetros e arquiteturas. Sistemas de AutoML especializados em fine tuning reduzirão a barreira técnica para implementação.

Além disso, few-shot learning avança na direção de especialização com exemplos mínimos. Técnicas emergentes podem permitir fine tuning eficaz com apenas dezenas de exemplos, expandindo aplicabilidade para nichos específicos.

Finalmente, multi-modal fine tuning integrará texto, imagem, áudio e vídeo em modelos únicos. Esta convergência permitirá aplicações mais ricas e compreensão contextual mais profunda.

Pronto para implementar fine tuning em seus acordos? Entre em contato com a Docusign e acelere sua transformação digital jurídica com IA especializada.

Fine tuning aplicado a contratos: Docusign Iris

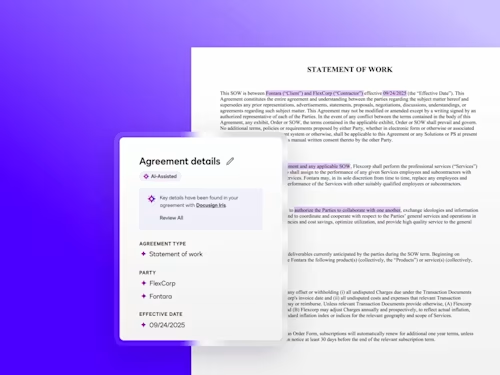

A Docusign Iris representa implementação exemplar de fine tuning aplicado ao domínio jurídico. Esta IA especializada foi treinada em milhões de contratos reais, desenvolvendo compreensão profunda da linguagem e estruturas contratuais.

Nesse sentido, esse processo de fine tuning aproveitou mais de duas décadas de experiência da Docusign em gestão de acordos. Esta base de conhecimento, combinada com tecnologia de ponta, resultou em uma IA que compreende nuances contratuais que modelos genéricos não capturam.

Além disso, os resultados práticos incluem redução de 83% no tempo de processamento CLM (de 24 para 4 horas) e automação de extrações de dados que anteriormente demandavam revisão manual extensiva.

Veja na prática como o fine tuning pode transformar seus processos contratuais por meio da plataforma IAM da Docusign, que integra Iris para oferecer gestão inteligente de acordos.

FAQ

Fine tuning é melhor que usar ChatGPT diretamente?

Fine tuning oferece especialização e controle que modelos genéricos não conseguem. Enquanto ChatGPT é excelente para tarefas gerais, por outro lado, modelos com fine tuning como Docusign Iris são treinados especificamente para domínios como análise de contratos, oferecendo maior precisão e relevância para casos de uso específicos.

Quanto tempo demora para fazer fine tuning de um modelo?

O tempo varia conforme complexidade e recursos disponíveis. Fine tuning básico pode levar algumas horas, enquanto projetos complexos podem demandar semanas de desenvolvimento. Além disso, técnicas como LoRA reduzem significativamente esse tempo, permitindo especialização rápida mesmo em hardware limitado.

Fine tuning funciona com poucos dados?

Sim, essa é uma das principais vantagens do fine tuning. A técnica pode funcionar com datasets milhares de vezes menores que o treinamento original. Dessa forma, técnicas few-shot permitem especialização com apenas centenas de exemplos de qualidade, tornando viável para nichos específicos.

É possível fazer fine tuning sem conhecimento técnico avançado?

Plataformas modernas democratizam o acesso ao fine tuning. Soluções como Docusign IAM integram fine tuning de forma transparente, permitindo que profissionais de negócios aproveitem os benefícios sem expertise técnica profunda. Além disso, serviços gerenciados abstraem a complexidade técnica.

Fine tuning pode piorar o desempenho do modelo?

Sim, se executado incorretamente. Overfitting e esquecimento catastrófico são riscos reais quando o processo não é conduzido adequadamente. Por isso, empresas como Docusign investem em expertise especializada para garantir implementações bem-sucedidas que mantêm qualidade e especialização.

Com mais de 16 anos de experiência em tecnologia, atuo com foco em pré-vendas, venda de valor e arquitetura de soluções que viabilizam a transformação digital de forma estratégica. Atualmente lidero o time de Soluções Enterprise na DocuSign Brasil, ajudando empresas a alcançarem ganhos reais e efetivos nos negócios. Sou movido pela paixão de usar a tecnologia para melhorar processos, gerar impacto positivo e transformar a experiência das pessoas.

Publicações relacionadas

Docusign IAM é a plataforma de acordos que sua empresa precisa para o sucesso